Éducation

Société

L’enseignement supérieur, un business comme un autre ?

Société

Faire face au RN, avant qu’il ne soit trop tard

Pratiques

Syndicalisme

Faire des syndicats un « levier d’action contre le racisme »

Chroniques

Revue de presse

« Chasse aux sorcières » anti-diversité : par-delà l’Atlantique ?

Chroniques

Droit privé

Droits

Le droit à la formation syndicale conforté

Management

Organisation du travail

« Severance » : pour vivre heureux, vivons dissociés ?

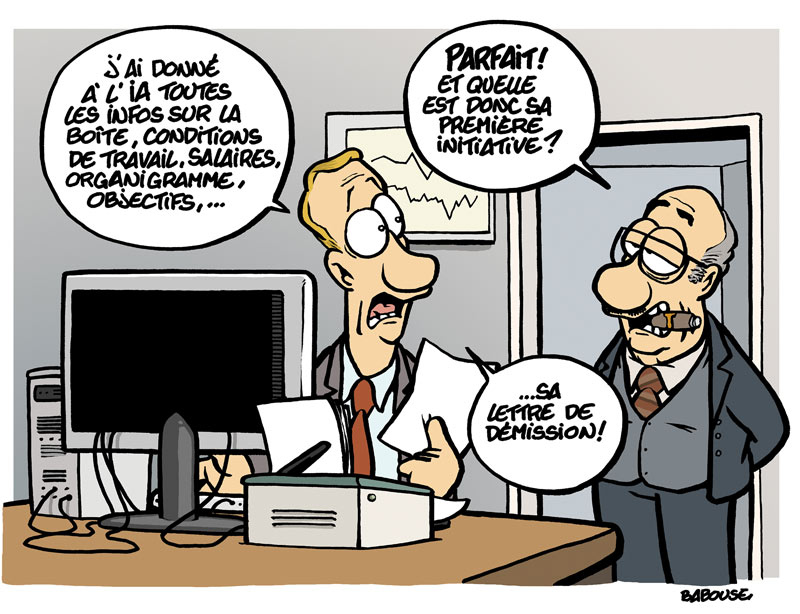

Dessin

Babouse — Faire face au RN, avant qu’il ne soit trop tard

Dessin

Pessin — « Chasse aux sorcières » anti-diversité : par-delà l’Atlantique ?

Livres

Romans

Romans – Quand le fascisme toque à la porte

Livres

Polars

Polars – Fuite et survie dans les Ozarks

Culture

Quand Alfred Dreyfus en personne revient sur « l’Affaire »

Sorties

L’hygiène, au Moyen Âge, c’était tout de même du propre

Culture

Sorties

Face à face entre la soldate israélienne et l’adolescent palestinien

Culture

Sorties

L’agenda culturel d’avril 2025